AI 시장에서 동시에 일어나고 있는 두 가지 흐름이 있습니다. 너무 다른 방향이라 같은 시장 이야기가 맞나 싶을 정도입니다.

한쪽에서는 엔비디아가 올해에만 AI 지분 투자에 400억 달러를 쏟아부었습니다. 한국 돈으로 약 60조 원입니다. GPU를 파는 회사가 GPU를 사는 회사들의 지분을 직접 사들이고 있습니다. 다른 한쪽에서는 12GB VRAM의 일반 게이밍 그래픽카드에서 35B(350억 파라미터) 모델이 초당 80토큰으로 돌아갑니다. 1년 전이라면 데이터센터급 장비가 필요했던 일이, 지금은 게이머의 책상 위 PC에서 실시간으로 일어납니다.

빅테크는 자본으로 위를 잠그고, 오픈소스는 효율화로 아래에서 파고듭니다. 그 사이에 끼어 있는 것이 우리 모두입니다.

엔비디아의 변신: GPU 제조사에서 AI 자본가로

400억 달러는 한국 정부 1년 R&D 예산의 두 배가 넘는 금액입니다. 이 돈으로 엔비디아가 한 일은 AI 스타트업과 인프라 회사들의 지분을 직접 사는 것입니다.

이게 왜 의미가 있나. 지금까지 엔비디아의 사업 모델은 단순했습니다. GPU를 만들어서 팝니다. 그게 끝이었습니다. 그런데 이제 엔비디아는 자기 GPU를 사는 회사들의 지분을 갖고, 그 회사들이 더 많은 GPU를 사도록 자금을 댑니다.

이건 단순한 투자가 아닙니다. 자기가 자기에게 돈을 도는 닫힌 순환 구조입니다.

엔비디아의 자기강화 투자 순환

이 구조가 만들어내는 효과는 두 가지입니다. 단기적으로는 엔비디아의 매출과 기업 가치가 더 빠르게 늘어납니다. 장기적으로는 AI 인프라 생태계 전체가 엔비디아 표준에 종속됩니다. AMD나 인텔이 뒤늦게 따라잡으려 해도, 이미 엔비디아 자본으로 짜인 생태계 안으로 들어오기 어렵습니다.

GPU를 만드는 회사가 AI 생태계 자본가로 역할을 전환했다는 게 핵심입니다. 시장의 인프라 레이어를 자본력으로 봉쇄하는 전략입니다.

오픈소스의 반격: 12GB GPU에서 35B 모델이 돕니다

같은 시점, 정반대 방향의 일이 벌어지고 있습니다.

DeepSeek V4가 FP4 양자화 기법(QAT)을 공개했습니다. 양자화는 AI 모델의 숫자 정밀도를 낮춰서 메모리 사용량을 줄이는 기술입니다. 모델 크기가 줄면 더 작은 GPU에서 돌릴 수 있습니다.

Qwen3.6은 MTPMulti-Token Prediction추론으로 같은 GPU에서 더 빠른 속도를 냅니다. 한 번에 한 토큰씩 만드는 게 아니라, 여러 토큰을 동시에 예측합니다.

이 두 기법이 합쳐진 결과가 충격적입니다. 12GB VRAM. 일반 게이머가 쓰는 RTX 4070 한 장 수준입니다. 거기서 35B 파라미터 모델이 초당 80토큰으로 돌아갑니다. 사람이 읽는 속도보다 빠릅니다.

작년만 해도 35B 모델을 쓰려면 A100 같은 데이터센터 GPU가 필요했습니다. 한 장에 1만 5천 달러가 넘습니다. 지금은 50만 원짜리 게이밍 그래픽카드에서 같은 일이 가능합니다.

이게 의미하는 것은 명확합니다. AI를 돌릴 수 있는 사람이 폭발적으로 늘어납니다. 데이터센터를 빌릴 돈이 없어도, 클라우드 비용을 감당할 수 없어도, 자기 PC에서 AI를 직접 돌릴 수 있는 시대가 옵니다.

낸드 가격 40% 급락이 신호하는 것

여기에 하나 더 흥미로운 데이터가 추가됐습니다. 한국 낸드플래시 현물가가 한 달 사이 40% 급락했습니다. AI 메모리 슈퍼사이클 서사가 시작된 이후 처음 등장한 역방향 신호입니다.

낸드 가격이 떨어진 이유를 단순하게 보면, 공급이 수요를 초과하고 있다는 뜻입니다. AI 데이터센터가 메모리를 빨아들이고 있다는 이야기와 정반대입니다.

가능한 해석은 두 가지입니다.

첫째, AI 인프라 투자 과잉의 조기 경보 신호. 모두가 AI 데이터센터를 짓고 있다고 생각해서 메모리 회사들이 공격적으로 생산을 늘렸는데, 실제 데이터센터 가동은 그만큼 빠르게 늘지 않고 있을 수 있습니다. 호가와 실수요 사이의 디커플링입니다.

둘째, AI가 메모리를 덜 먹는 방향으로 진화하는 신호. FP4 양자화 같은 효율화 기법이 보편화되면, 같은 모델을 돌리는 데 필요한 메모리 양이 절반 이하로 줄어듭니다. 데이터센터 사업자 입장에서 메모리를 덜 사도 같은 일을 할 수 있게 됩니다.

어느 쪽이든, "AI가 들어오면 메모리 수요가 무한히 늘어난다"는 단순한 시나리오는 깨지고 있습니다. 낸드 가격은 시장의 첫 번째 균열 신호입니다.

샌드위치 구조에서 살아남는 법

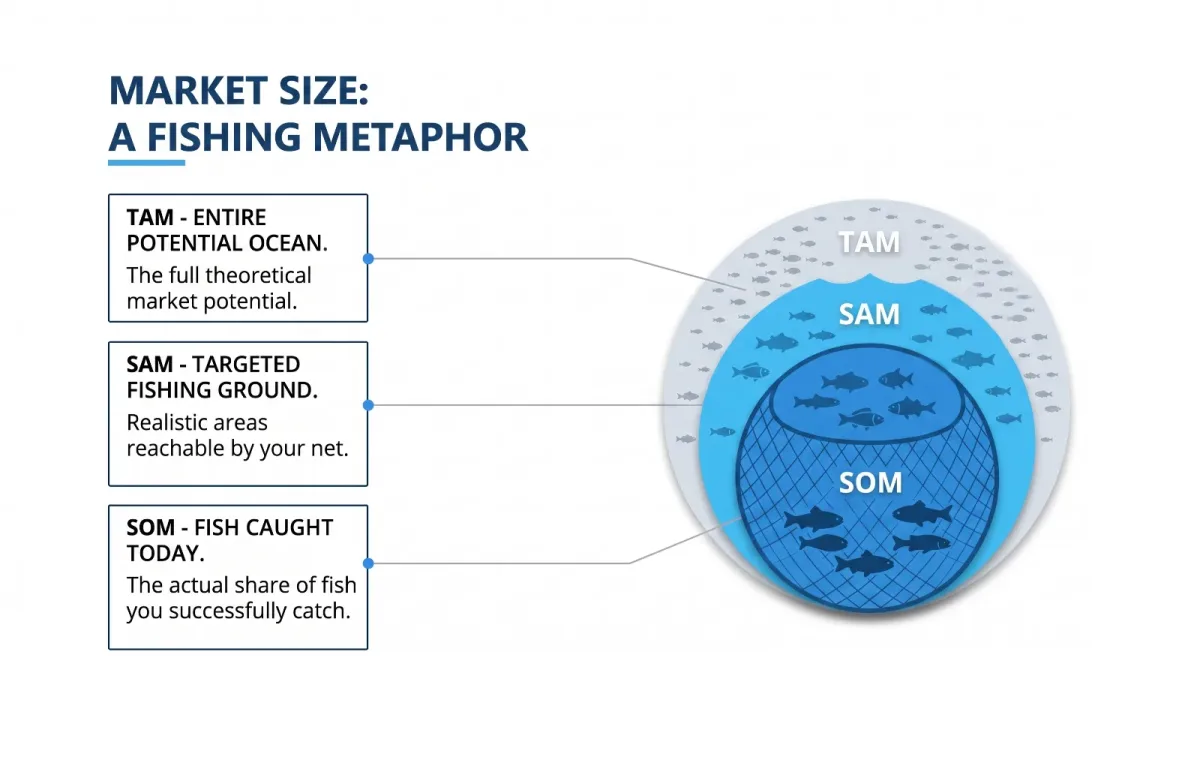

지금 시장 구조를 정리하면 이렇습니다.

상단: 엔비디아 + OpenAI + 빅테크. 자본과 인프라를 독점하면서 폐쇄형 생태계를 만듭니다. 한 번의 API 호출에 비용이 발생하고, 그 비용은 빅테크에게 흘러갑니다.

하단: 오픈소스 + 효율화 기술. 12GB GPU로 35B 모델을 돌립니다. API 호출 없이, 클라우드 의존 없이, 자기 컴퓨터에서 AI를 씁니다.

중간: 그 사이에 낀 모든 사람과 회사. 빅테크 API에 의존하면 비용이 점점 커지고, 자체 인프라를 갖추기엔 자본이 부족하고, 오픈소스를 돌리려니 기술 인력이 부족합니다.

이 구조에서 살아남는 전략은 양쪽 끝을 모두 활용하는 것입니다.

전략 1: 빅테크 API는 핵심 가치에만 쓴다. 모든 작업을 클로드나 GPT에 던지는 게 아니라, 정말 추론력이 필요한 부분에만 씁니다. 단순 분류, 요약, 키워드 추출 같은 작업은 오픈소스 모델로 처리합니다. 비용이 10분의 1로 줄어듭니다.

전략 2: 자체 인프라의 진입 장벽이 낮아지고 있다는 점을 활용한다. 1년 전에는 자체 AI 인프라를 갖추는 게 대기업의 영역이었습니다. 지금은 게이밍 PC급 장비로도 의미 있는 작업이 가능합니다. 작은 회사도 민감한 데이터를 외부로 보내지 않는 자체 AI 시스템을 가질 수 있습니다.

전략 3: 의존성을 분산한다. 한 빅테크 API에만 묶이면 가격 인상, 정책 변경, 서비스 중단 모두에 취약합니다. 클로드, GPT, 제미나이를 작업 성격에 따라 다르게 쓰고, 일부는 오픈소스로 자체 운영합니다. 데이비드 조지가 말한 "AI 시대 두 가지 길" 중 효율성으로 가는 길이 여기에 해당합니다.

로보틱스가 먼저 가는 이유

오늘 같은 날 또 하나 의미 있는 발표가 나왔습니다. 엔비디아가 GR00T 로보틱스 모델을 공개했고, 동시에 "LLMs corrupt documents"라는 연구가 발표됐습니다. 두 사건이 같은 날 일어난 것이 시사하는 바가 있습니다.

LLM이 문서를 손상시킨다는 연구는, 텍스트 기반 AI 에이전트의 신뢰성에 한계가 있다는 점을 다시 한번 보여줍니다. 사무직 일을 AI에게 맡기는 데는 아직 검증할 게 많이 남아 있다는 뜻입니다.

그 사이 로보틱스 모델은 빠르게 발전합니다. 물리적 작업, 제조, 물류 같은 영역에서 AI가 사람의 일을 대체하는 속도가 사무직 영역보다 빠를 수 있다는 신호입니다. 텍스트의 신뢰성 문제가 해결되기 전에, 물리적 행동의 영역이 먼저 열리고 있습니다.

이건 한국 제조업과 물류 산업에 직접적인 영향을 미치는 흐름입니다. 사무직 자동화는 천천히 오는데, 물리적 자동화는 생각보다 빨리 올 수 있습니다.

우리가 봐야 할 신호

오늘의 뉴스를 종합하면 세 가지 신호가 보입니다.

첫째, AI 인프라 투자가 자본 게임이 됐다. 400억 달러는 개별 회사가 따라갈 수 있는 규모가 아닙니다. 하드웨어 레이어에서의 경쟁은 사실상 끝났다고 봐야 합니다. 우리는 그 위에서 무엇을 할지를 고민해야 합니다.

둘째, 효율화가 새로운 차별화 포인트다. 빅테크가 자본으로 상단을 잠그는 동안, 오픈소스는 효율로 하단을 열고 있습니다. 자기 사업에 AI를 도입하려는 회사라면, 비용 효율적인 운영 구조를 만드는 능력이 핵심 역량이 됩니다.

셋째, AI 메모리 슈퍼사이클은 영원하지 않다. 낸드 가격 40% 급락은 단발성 사건이 아니라 추세의 첫 신호일 수 있습니다. AI 인프라에 무조건 베팅하는 단순한 전략의 시기는 지났습니다. 어느 영역이 정말 성장하고 어느 영역이 과잉 투자인지 구분하는 안목이 필요해집니다.

빅테크가 위에서 잠그고 오픈소스가 아래에서 파고드는 샌드위치 구도. 이 구도에서 우리가 어디에 서 있을지를 결정해야 하는 시점입니다. 위로 올라가서 자본 게임에 참여할 수는 없습니다. 그렇다면 아래에서 효율을 무기로 자기 자리를 만들거나, 두 끝을 영리하게 조합해서 사이를 채우는 것이 길입니다.

오늘의 시장은 그 길을 찾을 시간이 점점 줄어들고 있다고 말하고 있습니다.