규모와 품질, 중국과 미국의 선택

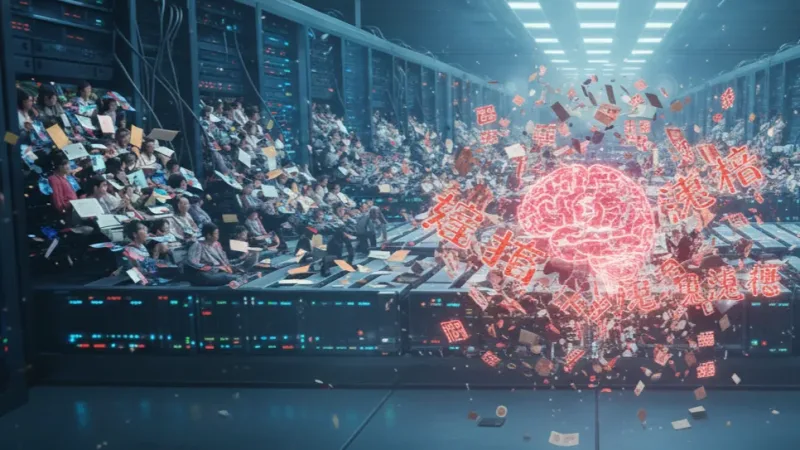

텐센트의 생성형 AI 위안바오가 새해 인사 이미지에 욕설을 삽입하는 사고가 발생했습니다. 개발사는 "다중 대화 처리 과정 오류"라고 해명했지만, 이는 빙산의 일각일 뿐입니다.

AI가 욕설을 하는 것은 우연이 아닙니다. 왜 그럴까요? 모델이 학습한 데이터 품질이 그대로 결과물에 반영되기 때문입니다.

미국과 중국의 AI 개발 방식은 어떻게 다를까요? OpenAI는 GPT-4 학습에 사용된 데이터 출처와 품질 관리에 막대한 비용을 투입했습니다. 반면 중국 기업들은 인해전술로 데이터를 수집하는 방식을 택했습니다.

구체적인 수치를 볼까요? 2023년 스탠포드 HAI(Human-Centered AI Institute) 보고서에 따르면, 중국 주요 AI 기업들은 평균적으로 미국 기업 보다 10배 많은 데이터를 수집하지만, 데이터 품질 관리에 투입하는 비용은 3분의 1 수준입니다.

바이두의 어니봇(文心一言)은 5,500억 개의 중국어 토큰을 학습했다고 발표했습니다. 하지만 이 데이터 중 상당 부분이 웨이보, TikTok 등 소셜미디어에서 무차별 수집된 것으로 알려져 있습니다.

데이터 수집의 함정

그런데 정말 문제는 무엇일까요? 중국 인터넷 환경은 AI 학습에 특별한 도전을 제시합니다. 중국 사이버보안협회(CSA)의 2024년 보고서는 중국 온라인 공간에서 "비속어와 공격적 언어" 사용 빈도가 다른 언어권 보다 40% 높다고 분석했습니다.

핵심은 데이터 양이 아니라 선별 과정입니다. 텐센트는 WeChat 메신저에서만 일일 300억 개의 메시지 데이터에 접근할 수 있습니다. 하지만 이 방대한 데이터에 욕설, 혐오 표현, 가짜 정보가 무분별하게 섞여 있습니다.

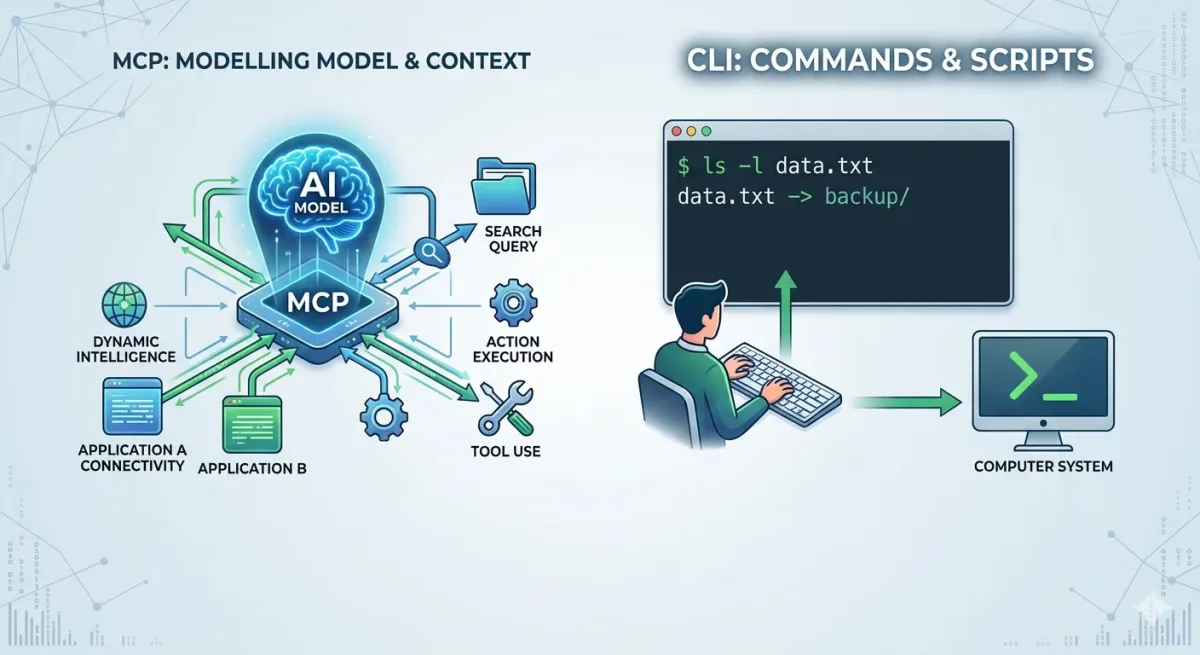

반면 OpenAI는 어떻게 할까요? Common Crawl 데이터를 사용하되, 수십 단계의 필터링 과정을 거칩니다. 특히 Constitutional AI 기법을 도입해 AI가 스스로 부적절한 반응을 억제하도록 훈련시킵니다.

인해전술의 한계

숫자로 비교해볼까요? 알리바바 통이치엔(通义千问) 개발팀은 2023년 "1,000명 주석 작업자가 6개월간 데이터 라벨링 작업을 진행했다"고 밝혔습니다. 하지만 GPT-4는 5,000명 이상의 전문가가 2년간 데이터 큐레이션에 참여했습니다.

여기서 중요한 깨달음이 나옵니다. 단순한 인력 투입으로는 데이터 품질을 보장할 수 없습니다. 중국 AI 기업들의 급속한 서비스 출시 압박이 이 문제를 더욱 악화시킵니다. "빨리, 많이"라는 논리가 "정확히, 안전하게"를 밀어낸 결과입니다.

구글 딥마인드(DeepMind)의 2024년 연구는 "저품질 데이터 10TB보다 고품질 데이터 1TB가 더 나은 성능을 보인다"는 결론을 내렸습니다. 즉, 데이터는 많을수록 좋은 것이 아닙니다. 좋을수록 좋은 것입니다.

문화적 맥락의 간과

위안바오 욕설 사건은 기술적 오류가 아닌 문화적 맥락 실패입니다. AI가 학습한 중국 온라인 문화의 공격성과 직설적 표현이 그대로 드러난 것입니다.

이것이 바로 "데이터 문화의 거울 효과"입니다. AI는 학습한 사회의 언어 습관을 고스란히 반영하는 거울입니다. 거울에 비친 모습이 마음에 들지 않는다고 거울을 탓할 수는 없습니다.

그럼 답은 무엇일까요? 진정한 AI 경쟁력은 데이터 양이 아니라 질에서 나온다는 것입니다. 중국 AI가 글로벌 신뢰를 얻으려면 인해전술을 버리고 데이터 품질 혁신에 집중해야 합니다.

그렇지 않으면 앞으로도 새해 인사에 욕설이 끼어드는 일이 반복될 것입니다.

Garbage in,

Garbage out.

이보다 명확한 진단이 또 있을까요?