경영 컨설턴트 위안 헝 팬Yuan Heng Fan은 600만 원이 넘는 M4 맥스 맥북프로 64GB RAM을 주문했습니다. 파워포인트와 엑셀만 돌리기에는 과분한 성성능이었습니다. 그래서 그는 하루 만에 완전히 로컬에서 작동하는 AI 어시스턴트 'NG-Notebook'을 만들어냈습니다.

이 프로젝트는 기업 환경에서 AI를 다루는 근본적 딜레마를 해결한 사례입니다. M&A 문서, 재무제표, 전략 계획서 같은 기밀 데이터를 ChatGPT에 업로드하는 것은 보안상 불가능합니다. 구글의 NotebookLM 역시 엑셀.xlsx과 파워포인트.pptx 파일을 기본 지원하지 않습니다. 그렇다면 민감한 기업 데이터를 안전하게 다루면서도 AI의 지능을 활용할 방법은 없을까요?

맥북 안에서 완결되는 AI 생태계

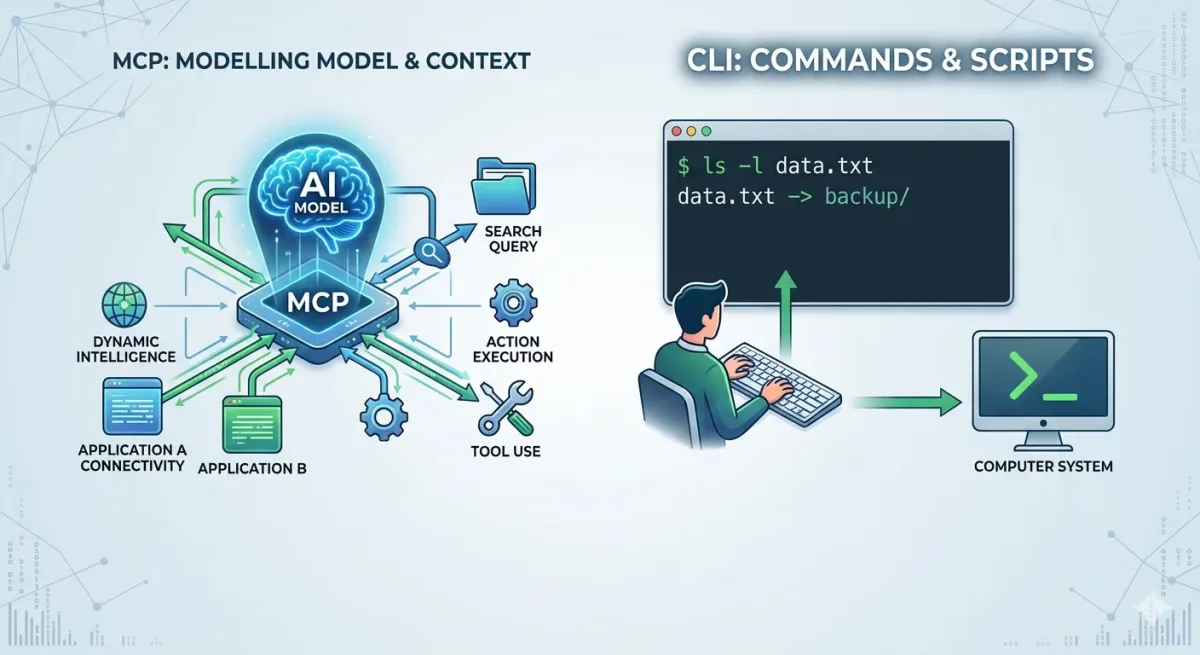

팬이 구축한 시스템의 핵심은 네 가지 구성 요소입니다. 먼저 두뇌 역할을 하는 대형 언어 모델LLM로는 Ollama를 택했습니다. Ollama는 메타의 라마 3 같은 오픈소스 AI 모델을 맥 실리콘에서 직접 구동할 수 있게 해주는 관리 도구입니다. 클라우드 서비스 없이 맥북 안에서만 '생각'이 일어납니다.

신경계 역할은 LangChain이 담당합니다. LangChain 자체는 사고하지 않지만, AI 두뇌와 다른 구성 요소들을 연결하는 배관 역할을 합니다. 문서 처리와 검색 기능을 통해 AI가 파일을 읽고 이해할 수 있게 만듭니다. 마지막으로 Streamlit으로 구축한 웹 인터페이스가 사용자와 AI 사이의 대화창 역할을 합니다.

놀라운 점은 이 모든 시스템이 하루 만에 완성되었다는 사실입니다. AI 과학자가 아닌 일반 비즈니스 전문가도 맞춤형 AI를 구축할 수 있는 시대가 왔습니다.

기업 AI의 자체 제작 시대

이 프로젝트는 단순한 기술 데모를 넘어섭니다. 기업이 AI에 접근하는 방식의 근본적 변화를 보여줍니다.

보안과 맞춤화가 핵심이 됩니다. 범용 AI 도구는 강력하지만 원사이즈핏올one-size-fits-all 솔루션의 한계가 명확합니다. 기업용 AI의 미래는 범용 챗봇 사용이 아닙니다. 위험 없이 독점 데이터와 내부 시스템을 다룰 수 있는 안전하고 사적이며 고도로 맞춤화된 AI 에이전트 배포가 답입니다.

M4 맥스 같은 고성능 로컬 디바이스에서 AI 애플리케이션을 구동하는 능력은 데이터 보안 측면에서 규칙을 바꾸고 있습니다. 기밀 정보가 기기 밖으로 나가지 않는다는 보장은 금융, 법률, 의료 분야에서 결정적 장점이 됩니다.

AI 사용자에서 AI 창조자로

팬의 경험이 시사하는 바는 명확합니다. AI를 단순히 사용하는 단계에서 AI를 만드는 단계로 넘어가야 한다는 것입니다.

기존의 '그림자 IT' 현상이 AI 영역에서도 나타나고 있습니다. 직원들이 공식 승인 없이 ChatGPT나 클로드를 업무에 활용하는 것이 그 예입니다. 하지만 이제는 더 나아가 각자의 필요에 맞는 AI 도구를 직접 구축할 수 있는 역량이 요구됩니다.

Ollama, LangChain, Streamlit 같은 도구들이 이미 존재합니다. 문제는 기술적 장벽이 아니라 시도하려는 의지입니다. 컨설턴트가 하루 만에 해낸 일을 다른 전문가들이 못할 이유는 없지 않겠습니까?

M4 맥스 64GB RAM이라는 하드웨어 투자도 더 이상 과도하지 않습니다. 이 정도 사양이면 엔터프라이즈급 AI 워크로드도 충분히 감당합니다. 클라우드 API 비용을 고려하면 오히려 경제적일 수 있습니다.

결국 질문은 하나입니다. 당신은 AI를 쓰는 사람으로 남을 것인가, 아니면 AI를 만드는 사람이 될 것인가? 팬의 하루짜리 프로젝트가 증명했듯, 그 경계선은 생각보다 가깝습니다.